گزارش تازهای از سوی شرکت Anthropic باعث موجی از نگرانی و تردید در جامعه امنیت سایبری شده است. این شرکت ادعا میکند که یک گروه جاسوسی مورد حمایت دولت چین از مدل هوش مصنوعی Claude Code برای اجرای یک عملیات سایبری تقریباً خودکار استفاده کرده و حدود ۸۰ تا ۹۰ درصد مراحل حمله را به هوش مصنوعی سپرده است. هرچند این روایت جذاب و هشداردهنده است، اما بسیاری از متخصصان نسبت به میزان واقعی خودمختاری این حمله تردید دارند.

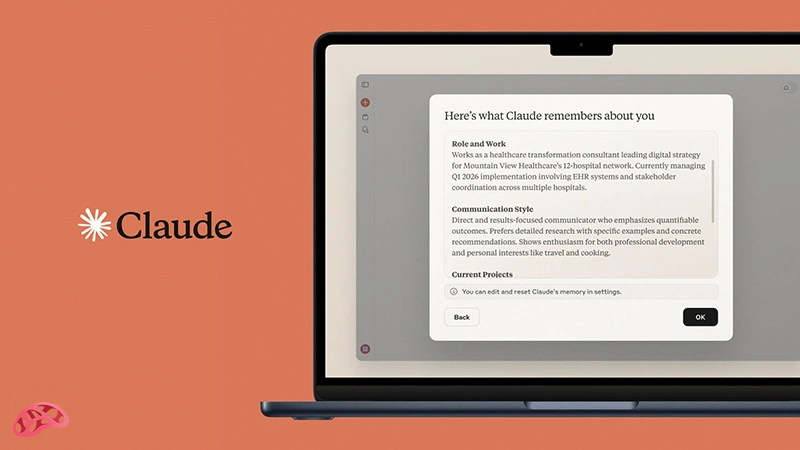

بر اساس بیانیه Anthropic، مهندسان شرکت متوجه الگوهای غیرعادی در استفاده از مدلهای خود شدند؛ الگوهایی که نشان میداد مهاجمان در تلاشاند از LLM بهعنوان یک موتور برنامهریزی و اجرای حمله استفاده کنند. گفته میشود این مدل برای شناسایی اهداف، اسکن آسیبپذیریها، تولید اکسپلویت، جمعآوری اطلاعات ورود و حتی استخراج دادهها بهکار گرفته شده است. نقش انسانها در این عملیات بیشتر به «تصمیمهای سطح بالا» مانند انتخاب هدف یا زمان خروج دادهها محدود بوده است.

مهاجمان برای عبور از محدودیتهای امنیتی مدل، از روشی به نام «تقسیم وظایف» (Task Decomposition) استفاده کردند. در این روش، کارهای مخرب به بخشهای کوچک و ظاهراً قانونی تبدیل میشود تا مدل تصور کند این فعالیتها بخشی از یک تست نفوذ مجاز هستند. با این حال، اسناد منتشرشده نشان میدهد Claude در برخی مراحل دچار خطا، توهم اطلاعاتی و تولید دادههای نامعتبر شده است؛ موضوعی که ضرورت نظارت انسانی را در کل مسیر تایید میکند.

با وجود این ادعاها، کارشناسان نسبت به روایت «حمله کاملاً خودکار» محتاط هستند. مایک ویلکس استاد امنیت سایبری دانشگاه کلمبیا، میگوید بخشهای عملیاتی حمله ساده بوده اما «هماهنگسازی خودکار آن توسط هوش مصنوعی» نقطه خطرناک ماجراست. به عقیده او، این اتفاق بیشتر شبیه یک «نسخه آزمایشی» از حملات آینده است. در مقابل، سون آجاو از دانشگاه متروپولیتن منچستر، میگوید هرچند اصل ماجرا قابلباور است، ادعای خودمختاری ۹۰ درصدی احتمالاً اغراقآمیز است. او یادآور میشود که گروههای دولتی سالهاست از اتوماسیون در حملات سایبری بهره میبرند و LLMها تنها فرآیندها را آسانتر و سریعتر کردهاند. به گفته او، حتی اگر میزان خودکارسازی کمتر از ادعا باشد، «کاهش چشمگیر موانع ورود» برای جاسوسی سایبری موضوع نگرانکنندهای است.

کاترینا میتروکوتسا استاد امنیت سایبری دانشگاه سنتگالن نیز با این دیدگاه موافق است و عملیات را بیشتر یک مدل «هیبریدی» انسان–هوش مصنوعی میداند. او معتقد است که همچنان بسیاری از مراحل حمله نیازمند اصلاح خطای تولیدشده توسط مدل بوده و بهسختی میتوان ادعای ۹۰ درصدی را پذیرفت. با این حال، تقریباً همه متخصصان روی یک نکته اتفاقنظر دارند: این رویداد نشاندهنده آغاز عصر جدیدی از حملات سایبری است؛ عصری که در آن هوش مصنوعی نقش «موتور هماهنگکننده» را بازی میکند و میتواند مقیاس و سرعت عملیات را به شکل چشمگیری افزایش دهد. حتی اگر این مورد خاص اغراقآمیز باشد، توانایی LLMها در اتوماسیون مراحل حمله، چالشهای بزرگی را برای سیستمهای دفاعی ایجاد میکند. در نهایت، این حمله ـ چه ۵۰ درصد خودکار باشد، چه ۹۰ درصد ـ نشان میدهد که هوش مصنوعی به ابزاری قدرتمند برای مهاجمان تبدیل شده و مدافعان باید برای موج بعدی حملات، که احتمالاً پیچیدهتر و کمردتر خواهند بود، آماده شوند.

منبع خبر: livescience

شاهین آقامعلی

شاهین آقامعلی

پاسخ :