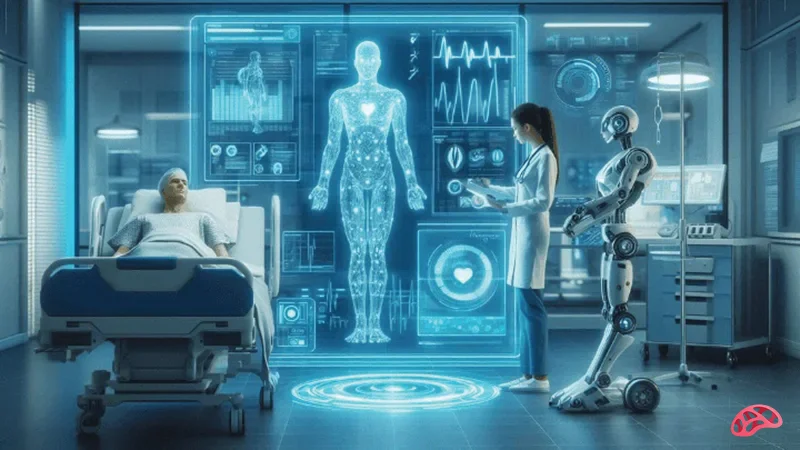

استفاده از هوش مصنوعی در حوزه پزشکی و سلامت با سرعتی چشمگیر در حال رشد است. از الگوریتمهای تفسیر اسکنها و تصاویر گرفته تا سیستمهای هوشمند تشخیص بیماری و مدیریت بیمارستانها، هوش مصنوعی اکنون به بخش جداییناپذیر از ساختار درمانی جهان تبدیل شده است. با این حال، کارشناسان هشدار میدهند که این پیشرفتها میتواند چالشهای پیچیدهای را در زمینه مسئولیت حقوقی و خطاهای پزشکی ایجاد کند.

پروفسور «دِرِک آنگِس» از دانشگاه پیتسبورگ در این باره میگوید: «قطعاً موقعیتهایی پیش خواهد آمد که در آن، یک خطای پزشکی به وقوع میپیوندد و همه به دنبال فرد یا نهادی خواهند بود که مقصر است.» به گفته او، تعیین مسئولیت در مواردی که سیستمهای هوش مصنوعی نقش دارند، به دلیل تنوع بازیگران (از توسعهدهندگان گرفته تا پزشکان و بیمارستانها) بسیار دشوار است.

این نگرانیها در «نشست هوش مصنوعی JAMA» که توسط نشریه معتبر Journal of the American Medical Association برگزار شد، به طور گسترده مورد بررسی قرار گرفت. در این رویداد، متخصصان پزشکی، شرکتهای فناوری، نهادهای قانونگذار، بیمهگران، وکلا و اقتصاددانان درباره فرصتها و خطرات هوش مصنوعی در پزشکی گفتوگو کردند. نتیجه این نشست، گزارشی جامع به قلم آنگس و همکارانش بود که ضمن اشاره به مزایای هوش مصنوعی، بر ابعاد حقوقی و اخلاقی آن تمرکز داشت.

پروفسور «گلن کوهن» از دانشکده حقوق هاروارد، یکی از نویسندگان گزارش، اظهار داشت که بیماران در اثبات تقصیر یا نقص طراحی در محصولات هوش مصنوعی با مشکلات زیادی روبهرو خواهند بود. او گفت: «دسترسی به اطلاعات داخلی الگوریتمها دشوار است و حتی ممکن است نتوان بهسادگی ثابت کرد که نتیجه نامطلوب درمانی ناشی از عملکرد هوش مصنوعی بوده است.» وی افزود که در پروندههای قضایی، طرفین ممکن است تقصیر را به گردن یکدیگر بیندازند یا از قراردادهای موجود برای تغییر مسئولیت قانونی استفاده کنند.

پروفسور «میشل ملو» از دانشگاه استنفورد نیز خاطرنشان کرد که گرچه دادگاهها در نهایت قادر به حل این مسائل هستند، اما در مراحل ابتدایی، ناهماهنگی و تأخیر در رسیدگی میتواند هزینهها را برای کل اکوسیستم نوآوری و پذیرش هوش مصنوعی افزایش دهد. یکی دیگر از نگرانیهای مطرحشده در گزارش، نبود نظارت کافی بر ابزارهای هوش مصنوعی در حوزه سلامت است. بسیاری از این ابزارها خارج از نظارت سازمانهایی مانند سازمان غذا و داروی آمریکا (FDA) عمل میکنند. آنگس هشدار داد: «آنچه در مرحله آزمایشی مفید به نظر میرسد، ممکن است در محیط واقعی بیمارستان و میان بیماران متفاوت با نتیجه مطلوب همراه نباشد.» به گفته نویسندگان، ارزیابی عملکرد واقعی ابزارهای هوش مصنوعی دشوار است، زیرا بسیاری از آنها تنها در زمان استفاده بالینی میتوانند بهدرستی سنجیده شوند. از سوی دیگر، فرایندهای ارزیابی فعلی پرهزینه و پیچیدهاند.

در پایان گزارش تأکید شده است که دولتها و مراکز تحقیقاتی باید بودجه لازم برای ارزیابی دقیق عملکرد این ابزارها را فراهم کنند و سرمایهگذاری در زیرساختهای دیجیتال را جدی بگیرند. همانطور که آنگس اشاره میکند: «ابزارهایی که بهخوبی ارزیابی شدهاند، کمترین میزان استفاده را دارند، در حالی که آنهایی که بیشترین استفاده را دارند، کمتر مورد ارزیابی قرار گرفتهاند.» به نظر میرسد آینده پزشکی با هوش مصنوعی روشن اما پرچالش است؛ آیندهای که در آن فناوری و قانون باید همزمان پیشرفت کنند تا اعتماد عمومی و ایمنی بیماران حفظ شود.

منبع خبر: theguardian

شاهین آقامعلی

شاهین آقامعلی

پاسخ :