با پیشرفتهای روزافزون و سرسام آور در حوزه هوش مصنوعی، روزبهروز به دامنه اصطلاحات، تکنیکها و تکنولوژیهای مورد استفاده در این حوزه هم افزوده میشود. رباتهای چت پیشرفتهای مثل ChatGPT و یا Bard مدلهای مولد تصویر مثل مثل DALL-E همه و همه با کمکگرفتن از زیر شاخهها و تکنولوژیهای موجود در هوش مصنوعی مثل یادگیری ماشین، یادگیری عمیق، شبکههای عصبی و غیره پیاده سازی میشوند. امروزه با پیشرفت هوش مصنوعی در این حوزه با انواع مدلها، سیستمها و ماشینهای هوشمندی روبهرو هستیم که هر کدام از یک روش و تکنولوژی استفاده میکنند و قدرت میگیرند. هر شرکت در این حوزه برای پیشبرد اهداف خود از یک تکنیک و روش خاصی استفاده میکند و بعضاً این تکنیکها به خاطر کارآمدی بالا در حل مشکلات و پیاده سازی سیستمهای هوشمند به شکل گستردهای مورد استفاده قرار میگیرند. یکی از این مدلها و روشها، مدل ترانسفورمری یا Transformer Model میباشد. اگر جز افرادی هستید که با رباتهای چت محبوب مثل ChatGPT کار میکنید، شاید در مورد این رباتهای چت هوش مصنوعی این اصطلاح به گوشتان خورده و برایتان سؤال بوده باشد که مدلهای ترانسفورمری چه مدلهایی هستند و چگونه کار میکنند و یا اینکه چه کاربردی در رباتهای چت هوش مصنوعی دارند. در این مقاله قصد داریم این مدلها را بررسی کنیم و اطلاعاتی در مورد آنها به دست بیاوریم. در ادامه با آرتیجنسهمراه باشد.

مدل ترانسفورمری Transformer Model چیست؟

مدل ترانسفورمری که با نام مدل انتقالی هم شناخته میشود برای اولین بار در سال 2017 توسط گوگل به کار گرفته شد و بعدها به خاطر کارایی و عملکرد مناسب آن به صورت گسترده در پردازش زبان طبیعی مورد استفاده قرار گرفت. ترانسفورمر یک معماری جدید در شبکههای عصبی مصنوعی است که برای انجام وظایفی مثل ترجمه ماشینی مورد استفاده قرار میگیرد. این مدل از مکانیزم "توجه" برای تجزیه و تحلیل و ایجاد ارتباط بین اجزای مختلف ورودی استفاده میکند. مکانیزم "توجه" بخش مهمی از مدلهای ترانسفورمری است که بر روی اجزای مختلف ورودی تمرکز کرده و به هر کدام از بخشها وزن مناسب خود را میدهد و از این طریق اجزای ورودی را از نظر اهمیت الویت بندی میکند. در مدلهای ترانسفورمری توجه به صورت موازی روی تمام دادهها اعمال میشود و این یکی از وجه تمایزهای این نوع مدلها با دیگر مدلهای قدیمیتر است.

مدل ترانسفورمری چگونه کار میکند؟

در این قسمت پس از آشنایی با مفهوم مدلهای ترانسفورمری برای درک بهتر این معماری در شبکههای عصبی، روش کار این مدلها را در مراحل مختلف بررسی کرده و در مورد هر کدام توضیحاتی ارائه میدهیم:

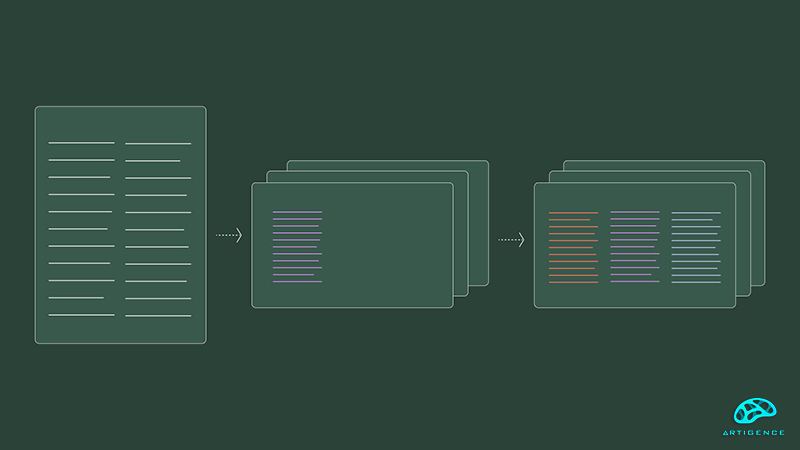

ورودی و تضمین مکالمه:

اولین مرحله در مدلهای ترانسفورمر دریافت ورودیها در قالب یک دنباله از واژگان یا نشانهها میباشد. این ورودیها ممکن است شامل متون زبانی، دنبالههای زمانی یا سایر دادههای توالی باشند. تضمین مکالمه یا positional encoding هم به مدل این امکان را میدهد تا از موقعیت و ترتیب ورودیها آگاه شود.

لایههای توجه:

مرحله دوم لایه توجه و مهمترین بخش در کارکرد مدلهای ترانسفورمری میباشد. این لایهها به مدل ترانسفورمری این امکان را میدهند تا بر روی اجزاء مختلف دنباله ورودیها تمرکز داشته باشد. لایه توجه از سه قسمت اصلی تشکیل میشود: کوئری (Query)، کلید (Key)، و مقدار (Value). با استفاده از محاسبات مبتنی بر ماتریس، مدل اطلاعات مهم را از دنبالههای ورودی استخراج میکند.

لایههای Feedforward:

پس از گذر از لایه توجه، هر دنباله، به دست آمده از لایه توجه توسط یک شبکه کاملاً متصل یا Feedforward تقویت میشود. این شبکه به صورت جداگانه بر روی هر واژه یا هر جز از ورودی اعمال میشود.

افزودن ویژگیها:

پس از پردازش اجزای داده در لایه Feedforward خروجی حاصل از این لایه با خروجی لایههای توجه جمع میشود. این ادغام امکان جمع آوری اطلاعات مهم از هر دو لایه را فراهم میکند.

تکرار لایهها و تولید خروجی:

این مراحل برای تعداد دفعات مشخصی از لایهها انجام میشوند تا نهایت منجر به تولید خروجی مشخصی شود. از خروجی به دست آمده از آخرین لایه ترانسفورمری برای انجام وظایفی همچون ترجمه ماشینی، تشخیص موجودیتها و عواملی از این دست استفاده میشود.

نمونههایی از مدلهای ترانسفورمری:

در اینجا شاید این سؤال پیش بیاید که مدلهای ترانسفورمری چقدر عمومی هستند؟ و در چه موردهایی از آنها استفاده شده است. به طور کلی در هر مسئلهای از حوزه هوش مصنوعی که نیاز به پردازش و تجزیه و تحلیل توالی دادهها باشد مدلهای ترانسفورمری میتوانند به کار گرفته شوند. در ادامه با نمونههای محبوبی از مدلهایی که از این معماری استفاده میکنند آشنا میشویم:

GPT (Generative Pre-trained Transformer):

اولین نمونه از لیست مدلهای ترانسفورمری GPT است. ChatGPT که یکی از محبوبترین مدلهای زبان بزرگ چت هوش مصنوعی است و توسط شرکت OpenaAI توسعه داده شده است بر اساس معماری Transformer ساخته شده است. مدل GPT از تکنیک پیش آموزشی یا (pre-training) بر روی حجم زیادی از دادههای متنی استفاده میکند و میتواند در وظایف مختلفی مانند ترجمه ماشینی و تولید متن به کار گرفته شود.

BERT (Bidirectional Encoder Representations from Transformers):

BERT یکی دیگر از مدلهای چت هوش مصنوعی است که توسط گوگل توسعه داده شده و یک مدل ترانسفورمر است که برای آموزش مدلهای پردازش زبان طبیعی استفاده میشود. این مدل به صورت دوطرفه یا (bidirectional) معماری شده است، به این معنی که از تمام کلمات موجود در یک جمله برای آموزش استفاده میکند.

T5 (Text-to-Text Transfer Transformer):

T5 هم یکی از مدلهایی است که از معماری ترانسفورمری استفاده میکند که بر اساس مفهوم "متن به متن" طراحی شده است. از این مدل میتوان برای انجام وظایف متنی گوناگون از جمله ترجمه ماشینی، پرسش و پاسخ، و تولید خودکار متن استفاده کرد.

نتیجه گیری:

در بحبوحه انقلاب هوش مصنوعی به جرات میتوان گفت که به کاری گیری مدلهای ترانسفورمری یکی از کلیدهای اصلی در ساخت و پیاده سازی مدلهای پیشرفتهتر و هوشمندتر در حوزه هوش مصنوعی میباشد. امروزه مدلهای هوش مصنوعی مثل ChatGPT و یا سیستمهای ترجمه ماشینی و تمام حوزههای هوش مصنوعی که به نوعی با پردازش زبان طبیعی درگیر هستند با مدلهای ترانسفورمری گرهخوردهاند. ترجمه ماشینی یکی از سیستمهای هوشمندی است که به شدت وابسته به مدلهای ترانسفورمری است. اما به طور کلی در تمام زمینهایی که از توالی از دادهها استفاده میشود، میتوان از مدل ترانسفورمری استفاده کرد. یکی از مزیتهای بزرگ استفاده از مدلهای ترانسفورمری سرعت بالای این مدلهاست که علت این سرعت بالا، قابلیت آموزش موازی است. از طرفی به خاطر وجود قابلیت استفاده مجدد میتوان از روند آموزش در انجام وظایف مشابه استفاده کرد. اما شاید یکی از مهمترین ویژگیهای مدلهای ترانسفورمری این باشد که با استفاده از لایههای توجه میتواند به صورت همزمان رو تمام اجزای دنباله تمرکز کند.

شاهین آقامعلی

شاهین آقامعلی

پاسخ :